IA empresarial: de la guerra de modelos a la guerra de plataformas

La IA empresarial ha dejado de decidirse solo por la calidad de los modelos. La verdadera batalla se juega ahora en las plataformas capaces de integrar inteligencia, datos, agentes, seguridad y trabajo real dentro de la empresa. OpenAI y Anthropic lideran parte del foco y la innovación percibida, pero Google y Microsoft cuentan con una ventaja estructural mucho más profunda. Apple, por su parte, puede ser relevante en consumo y en inferencia local profesional. La cuestión ya no es quién impresiona más, sino quién transforma mejor la organización.

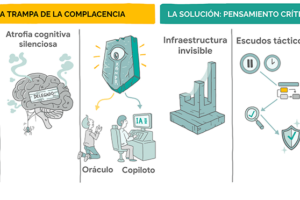

La inteligencia artificial ha dejado de ser una conversación sobre asombro tecnológico para convertirse en una conversación sobre poder operativo. Durante un tiempo, el mercado vivió fascinado por la carrera del modelo más brillante. Era una fase lógica. Cada salto en razonamiento, coding o multimodalidad parecía reescribir las reglas del juego. Pero cuando la IA empieza a entrar en los procesos reales de una organización, el criterio cambia. La pregunta ya no es quién impresiona más en una demo, sino quién puede sostener una transformación seria dentro de una empresa sin romper su seguridad, su lógica de trabajo ni su capacidad de control.

Ahí es donde el debate se vuelve realmente interesante. OpenAI y Anthropic han sido capaces de capturar el foco del mercado con una fuerza extraordinaria. Han actuado como dos superstartups con una intensidad poco común, empujando la frontera técnica, acelerando el ritmo de producto y obligando a todos los demás a reaccionar. Han marcado conversación, han generado prestigio tecnológico y han conseguido algo muy difícil: convertir la IA en una experiencia deseable. Pero cuando hablamos de IA empresarial, la cuestión central no es solo quién lidera la atención, sino quién puede instalarse con solidez en el tejido operativo de la organización.

Y ahí entran Google y Microsoft con una ventaja cualitativamente distinta. No solo tienen tecnología. Tienen empresa. Tienen infraestructura, identidad, colaboración, productividad, cloud, navegador, dispositivos, gobierno del dato y canales de distribución incrustados en el trabajo diario de millones de profesionales. Dicho de otra forma, no necesitan conquistar la empresa desde fuera; ya viven dentro de ella. Por eso esta batalla no puede leerse únicamente como una competición entre modelos avanzados, sino como una pugna mucho más profunda por controlar el entorno donde se va a ejecutar el trabajo asistido por IA.

En paralelo, aparecen otros nombres que generan ruido, curiosidad y titulares. Proyectos como OpenClaw o NemoClaw pueden funcionar como señales del futuro, como síntomas de hacia dónde se mueve el mercado o como laboratorios conceptuales que merece la pena observar. Pero una cosa es seguirlos con interés y otra muy distinta convertirlos en referencia para decisiones corporativas de hoy. La empresa no puede jugar con la seguridad, con la gobernanza ni con el cumplimiento normativo a partir de promesas emergentes. Puede explorarlas, puede vigilarlas y puede aprender de ellas, pero no debe confundir novedad con madurez. En la conversación actual sobre implantación de IA en entorno empresarial, esos nombres todavía pertenecen más al terreno de la expectativa que al de la arquitectura fiable.

Por eso este artículo parte de una idea muy concreta: la batalla decisiva ya no consiste en ver qué actor tiene el modelo más llamativo, sino en entender qué plataformas están en condiciones de convertir la inteligencia artificial en una capacidad estructural, segura y útil dentro de la empresa. Ese es el verdadero tablero. Y en ese tablero, la partida más relevante parece jugarse entre Google y Microsoft, aunque OpenAI y Anthropic sigan siendo actores imprescindibles para explicar la dirección técnica del mercado.

De la guerra de modelos a la guerra de plataformas

La primera gran ola de la inteligencia artificial generativa se interpretó como una guerra de modelos. El razonamiento era sencillo: quien construyera el mejor modelo tendría más posibilidades de dominar el mercado. Esa visión tuvo sentido mientras la innovación se medía, sobre todo, por la capacidad del sistema para responder mejor, generar mejor código, comprender mejor instrucciones o ampliar su ventana de contexto. En aquella fase, el modelo parecía el corazón completo del negocio.

Sin embargo, esa lectura se queda corta en cuanto la IA entra en la empresa. Una organización no transforma su operativa porque un modelo sea más brillante en abstracto. La transforma cuando esa inteligencia puede integrarse con documentos, reuniones, bases de datos, herramientas, procesos, permisos y políticas internas sin convertirse en una fuente adicional de riesgo. En ese momento, el modelo sigue importando, pero deja de ser el centro exclusivo del valor. Lo que empieza a importar de verdad es la plataforma que lo rodea.

Una plataforma de IA es mucho más que un motor de inferencia. Es una arquitectura completa que combina modelos, runtime de agentes, conectores, memoria, orquestación, superficies de uso, observabilidad, identidad y gobernanza . Es la diferencia entre tener una inteligencia potente y tener un sistema capaz de poner esa inteligencia a trabajar dentro de un entorno real sin perder control. Y ahí es donde se desplaza el valor del mercado. Ya no gana solo quien piensa mejor, sino quien logra que esa inteligencia opere de forma fiable, segura y distribuida en el trabajo diario.

Este cambio permite entender mejor la posición de cada actor. OpenAI y Anthropic han liderado con enorme fuerza la percepción de avance. Son más nativos de IA, más intensos en foco y, en muchos casos, más estimulantes desde el punto de vista del producto. Representan muy bien la lógica de dos superstartups que empujan la frontera desde una especialización radical. Pero esa misma condición marca también sus límites cuando la conversación se traslada a la empresa. Porque la empresa no premia solo el talento tecnológico; premia la capacidad de integrar ese talento en un entorno lleno de restricciones, dependencias y responsabilidades.

Google y Microsoft, en cambio, juegan con otra clase de activos. No solo desarrollan IA; la insertan sobre estructuras que ya articulan el trabajo de millones de personas. Google puede apoyarse en Workspace, Chrome, Android, Search, Vertex y una infraestructura vertical muy potente. Microsoft cuenta con identidad, permisos, productividad, colaboración, GitHub, Azure y una posición histórica dentro del entorno corporativo . Eso significa que, cuando la conversación pasa del laboratorio a la implantación, ambos tienen algo que OpenAI y Anthropic todavía están construyendo: una empresa debajo de la IA.

Aquí aparece una idea que conviene subrayar. La guerra de plataformas no consiste en negar la importancia del modelo, sino en colocar el modelo en su sitio correcto. Un mal modelo no sostiene una buena plataforma. Pero un gran modelo, por sí solo, tampoco construye una solución empresarial. Para eso hacen falta identidad, seguridad, trazabilidad, conectores con permisos, runtime fiable, gobierno del dato y presencia nativa en el flujo de trabajo. Dicho con una imagen simple: el mercado está dejando de premiar al fabricante del mejor motor aislado y empieza a premiar al constructor del vehículo completo.

Por eso también conviene ser muy prudentes con el ruido periférico del mercado. Siempre habrá nuevas etiquetas, nuevos nombres y nuevas promesas que intentarán colocarse en el centro de la conversación. Algunas acabarán siendo relevantes. Otras desaparecerán tan rápido como llegaron. Pero la empresa no puede permitirse implantar IA sobre entusiasmo sin madurez. En consumo, el error puede ser anecdótico. En empresa, puede convertirse en fuga de información, pérdida de control, incumplimiento normativo o deterioro de la confianza interna. Esa es la razón por la que hoy la conversación seria no debe girar alrededor del buzz, sino alrededor de las plataformas que ya están demostrando capacidad real de integración, gobierno y escala.

Eso es, precisamente, lo que define esta nueva etapa. La inteligencia artificial ya no compite solo por deslumbrar; compite por convertirse en infraestructura. Y cuando una tecnología entra en la infraestructura, cambian los ganadores, cambian los criterios y cambia la conversación. Lo decisivo ya no es quién hace más ruido, sino quién está en condiciones de rediseñar con solvencia el sistema operativo del trabajo.

Qué convierte a un proveedor en una plataforma de IA

Una plataforma de IA empresarial no se parece a una demo brillante. Se parece más a una ciudad bien diseñada. El ciudadano ve calles, edificios, semáforos y transporte. Pero para que esa ciudad funcione de verdad hacen falta redes eléctricas, agua, saneamiento, normativas, seguridad, señalización, mantenimiento y coordinación entre servicios. Si una de esas capas falla, la ciudad sigue en pie durante un tiempo, pero deja de ser fiable. Con la IA ocurre algo muy parecido. Lo importante no es solo que la inteligencia exista, sino que pueda operar dentro de una organización con utilidad, control y continuidad.

Por eso conviene mirar la plataforma como un stack de diez componentes. Cuando varias de estas piezas faltan o están mal resueltas, lo que tenemos no es una plataforma madura, sino una tecnología prometedora pero incompleta. Y en empresa, la distancia entre ambas cosas es enorme.

Los 10 componentes del stack de una plataforma de IA

1. Modelos fundacionales

Es la capa de inteligencia base. Aquí viven el razonamiento, el lenguaje, la generación de código, la capacidad multimodal y la comprensión de contexto. Es, si se quiere, el motor del sistema.

La analogía más útil es la de un coche de alta gama. El motor importa muchísimo. Sin motor no hay rendimiento, ni potencia, ni respuesta. Pero nadie confunde el motor con el coche entero. Puede ser extraordinario y, aun así, no bastar para circular con seguridad, comodidad y control. En la IA sucede lo mismo. El modelo es imprescindible, pero no es la plataforma completa.

2. Runtime de agentes

Aquí aparece una de las diferencias más importantes entre una IA que impresiona y una IA que realmente aporta valor operativo. El runtime de agentes es la capa tecnológica que permite que la inteligencia artificial no se limite a responder una instrucción aislada, sino que pueda mantener una tarea en marcha, coordinar varios pasos, utilizar herramientas, conservar estado, gestionar memoria operativa y dar continuidad a una acción dentro de un proceso real. En esta capa viven tecnologías como Responses API, Agents SDK y AgentKit en OpenAI; ADK, Agent Engine y Vertex AI Agent Builder en Google; Foundry Agent Service, Microsoft Agent Framework y Copilot Studio en Microsoft; o Claude Agent SDK y Managed Agents en Anthropic. Todas ellas cumplen, con enfoques distintos, una función parecida: convertir el modelo en un agente capaz de operar con cierta autonomía y persistencia.

La mejor manera de entenderlo es pensar en la diferencia entre una conversación puntual y una operación en curso. Una persona puede tener una idea excelente en una reunión y ofrecer una respuesta brillante en el momento. Pero si al día siguiente no recuerda qué se decidió, qué tarea quedó pendiente, quién debía intervenir después ni qué documentación había que consultar, esa inteligencia se queda en destello. El runtime resuelve precisamente ese problema. Es el sistema que da continuidad al trabajo, permite encadenar acciones, coordinar tareas y sostener la ejecución más allá del instante. Dicho de forma simple, el modelo pone la capacidad de pensar; el runtime pone la capacidad de trabajar.

3. Ejecución alojada y sandboxes

En cuanto la IA empieza a tocar archivos, ejecutar código o interactuar con procesos más delicados, surge una cuestión fundamental: dónde lo está haciendo y bajo qué límites. Los sandboxes son entornos controlados donde la IA puede actuar sin comprometer los sistemas críticos.

La lógica se entiende bien con una analogía industrial. Cuando una empresa prueba una nueva máquina, no la conecta sin más al núcleo de producción. Primero la valida en un entorno acotado, donde cualquier error pueda corregirse sin arrastrar toda la operación. En inteligencia artificial, ese principio de prudencia es exactamente igual. La capacidad de actuar solo es valiosa cuando va acompañada de un perímetro seguro.

4. Acceso a herramientas, navegador y sistema

Una IA empieza a generar valor real cuando deja de limitarse a contestar y pasa a interactuar con herramientas concretas: navegar, consultar una aplicación, lanzar un flujo, usar una API o trabajar sobre un sistema.

La analogía aquí es sencilla. El talento sin instrumentos tiene un alcance limitado. Una persona muy capaz sin acceso a agenda, documentos, correo, teléfono o aplicaciones de negocio puede pensar bien, pero le costará ejecutar. La IA funciona del mismo modo. Cuando solo habla, ayuda. Cuando además puede utilizar herramientas, empieza a producir resultados.

5. Memoria y gestión de contexto

Una IA sin memoria obliga a recomenzar continuamente. Una IA con memoria puede recordar proyectos, instrucciones, documentos, decisiones previas y estados de trabajo.

La mejor analogía es la de una relación profesional madura. Cuando existe contexto compartido, las conversaciones avanzan más rápido, las decisiones son más finas y el trabajo gana profundidad. Cuando cada interacción parte de cero, la relación se vuelve mecánica y costosa. La memoria transforma la IA de interlocutor episódico en colaborador con continuidad.

6. Conectores empresariales

Esta es una de las capas más decisivas. Los conectores permiten trabajar con correos, documentos, CRM, ERP, bases de datos, repositorios y otras herramientas reales de la organización.

Aquí sirve pensar en una red ferroviaria. Se puede tener una locomotora excelente, pero si no hay vías que conecten las ciudades importantes, el sistema no articula el territorio. Con la IA ocurre algo parecido. Sin conectores, la inteligencia trabaja en vacío. Con conectores, entra en contacto con la información viva del negocio. Pero hay un matiz esencial: no se trata solo de conectar, sino de conectar respetando permisos, roles y políticas de acceso. Si esa parte falla, lo que parecía eficiencia se convierte en exposición al riesgo.

7. Builder layer y orquestación

No toda organización va a desplegar inteligencia artificial escribiendo código desde cero. Necesita herramientas para diseñar flujos, construir agentes, coordinar tareas y definir reglas de funcionamiento. Aquí entran herramientas como Copilot Studio, Vertex AI Agent Builder, AgentKit, Apps SDK, Skills y otros entornos low-code o pro-code que hacen posible llevar la IA desde la idea hasta la implantación.

La analogía más clara es la de una mesa de mezclas. No basta con tener buenos instrumentos; hace falta una forma de coordinarlos para que produzcan una obra coherente. La orquestación cumple justamente esa función. Convierte piezas separadas en una operación con lógica, secuencia y propósito.

8. Superficies de aplicación

Esta capa responde a una pregunta crítica: dónde aparece la IA dentro del trabajo. Puede ser en el documento, en el correo, en el navegador, en el entorno de desarrollo o en la suite de productividad.

Aquí resulta útil pensar en la arquitectura de un edificio. No solo importa qué servicios tiene, sino cómo están distribuidos y cómo se accede a ellos. Si algo esencial queda lejos o fuera del recorrido natural, su uso cae. Con la IA sucede lo mismo. Cuanto más integrada esté en la superficie donde el trabajo ya ocurre, más natural será su adopción.

9. Distribución y go-to-market

En empresa, la mejor tecnología no siempre gana. Muchas veces gana la que mejor se despliega, la que ya tiene presencia en el entorno de trabajo y la que reduce el coste de adopción.

La analogía podría ser la de una red de carreteras frente a un vehículo aislado. Se puede tener un coche excelente, pero si no existe infraestructura para circular, el impacto es limitado. La distribución cumple esa función. Da capilaridad, facilita implantación y convierte una capacidad técnica en una presencia real dentro de la organización. Por eso Google y Microsoft parten con una ventaja tan estructural: no solo tienen IA, también tienen las autopistas por las que esa IA puede circular.

10. Gobernanza, identidad y seguridad

Esta es, probablemente, la capa más importante de todas. Define quién puede acceder a qué, qué puede hacer un agente, cómo se audita su actividad, qué límites tiene y cómo se protege la información sensible.

La imagen más útil aquí es la de un edificio corporativo con accesos diferenciados. No todas las personas pueden entrar en todas las plantas, abrir todos los despachos o consultar toda la documentación. El sistema funciona porque existe identidad, permisos y trazabilidad. La IA, en cuanto empieza a leer, decidir o actuar, necesita exactamente lo mismo. Sin esa capa, la organización no está desplegando inteligencia gobernable; está ampliando su superficie de riesgo.

La idea que debe quedar clara

Este esquema importa porque permite ver algo que el mercado simplifica demasiado: una plataforma de IA no es una inteligencia brillante con una interfaz atractiva. Es un sistema completo de capacidades integradas.

Y eso ayuda a leer mejor el tablero. OpenAI y Anthropic pueden liderar el foco, el prestigio técnico y parte de la innovación percibida. Pero Google y Microsoft parten con una ventaja muy difícil de replicar: no solo tienen IA, sino varias de las capas donde esa IA necesita vivir para ser útil en la empresa. Tienen superficies, distribución, identidad, conectores, productividad y control. Tienen, en definitiva, una estructura empresarial sobre la que la inteligencia puede apoyarse.

Por eso esta carrera no se va a decidir solo por quién construya el modelo más sofisticado. Se va a decidir por quién sea capaz de convertir esa inteligencia en una infraestructura real de trabajo.

OpenAI y Anthropic lideran el foco; Google y Microsoft tienen empresa

Una vez entendido el stack de una plataforma, la lectura del mercado se vuelve mucho más interesante. Porque entonces se ve con claridad que no todos los actores están compitiendo desde el mismo lugar ni con la misma lógica. En la superficie, todos parecen formar parte de la misma carrera. En realidad, juegan partidos parcialmente distintos.

OpenAI y Anthropic han sido, sin duda, los grandes aceleradores de esta nueva etapa. Han empujado la frontera tecnológica, han elevado la exigencia del mercado y han conseguido algo muy difícil: convertir la inteligencia artificial en una experiencia deseable antes de que estuviera plenamente institucionalizada. Han ganado atención, prestigio y narrativa. Han sido capaces de actuar con la intensidad de dos superstartups extraordinarias, concentradas casi obsesivamente en hacer que la IA sea mejor, más útil, más potente y más visible.

Y eso tiene un valor enorme.

Pero la empresa no se mueve solo por fascinación. Se mueve por reducción de riesgo, capacidad de integración, continuidad operativa y encaje con la arquitectura real del negocio. Ahí es donde cambia el ángulo. Porque OpenAI y Anthropic pueden liderar la conversación, e incluso en muchos casos la preferencia técnica, pero Google y Microsoft parten de una ventaja diferente: además de hacer IA, ya poseen buena parte del territorio donde esa IA tiene que vivir para generar valor empresarial.

Esa es la diferencia entre liderar el foco y tener empresa.

OpenAI ha construido una posición formidable como interfaz de uso y como referencia de producto. Ha conseguido que millones de personas entiendan la IA a través de ChatGPT y ha desarrollado una historia cada vez más seria en torno a agentes, herramientas, ejecución y empresa. Anthropic, por su parte, ha logrado una reputación extraordinaria en razonamiento, coding y trabajo experto, y ha convertido MCP en una pieza muy relevante dentro de la conversación sobre conectividad e interoperabilidad. Ambos están empujando el mercado con una fuerza que sería un error subestimar.

Sin embargo, cuando una organización se pregunta cómo implantar IA a escala, la conversación se desplaza. Ya no se trata solo de cuál es el mejor sistema en abstracto, sino de cuál puede convivir mejor con identidad corporativa, con permisos, con colaboración, con productividad, con compliance, con despliegue masivo y con herramientas que ya forman parte del día a día. Y en ese punto, Google y Microsoft tienen una ventaja estructural muy difícil de replicar.

Microsoft no parte desde fuera de la empresa. Parte desde dentro. Tiene Microsoft 365, Teams, Outlook, SharePoint, GitHub, Azure, Entra, Purview y una larga historia de convivencia con la complejidad organizativa. Puede gustar más o menos su velocidad de producto en IA, pero sería ingenuo no reconocer que controla varias de las capas más valiosas del stack: identidad, permisos, productividad, colaboración, distribución y gobierno del dato. En la práctica, eso significa que no necesita conquistar un espacio nuevo para insertar la IA; puede extenderla sobre infraestructuras donde ya se está haciendo el trabajo.

Google tiene una ventaja distinta, pero igual de seria. Combina modelos potentes, cloud, navegador, móvil, búsqueda y Workspace en una integración vertical muy difícil de igualar. Además, transmite hoy una sensación de mayor aceleración tecnológica en IA. Es decir, no solo tiene empresa; da la impresión de estar corriendo mejor en el plano estrictamente ligado a la evolución de la inteligencia artificial. Esa combinación hace que su posición sea especialmente interesante: tiene plataforma, tiene infraestructura y, además, parece más fino en esta fase de la carrera.

Por eso conviene no caer en una lectura simplista. No se trata de decir que OpenAI y Anthropic son actores menores. No lo son en absoluto. Tampoco se trata de afirmar que Google y Microsoft ya hayan resuelto la partida. No es verdad. Lo que sí parece claro es que el mercado se está ordenando en dos planos.

En el primer plano están quienes empujan la frontera de la IA con una intensidad extraordinaria. Ahí OpenAI y Anthropic siguen siendo decisivos. Son, en cierto sentido, los grandes especialistas, los que tensan el sistema, elevan expectativas y fuerzan al resto a acelerar. En el segundo plano están quienes, además de competir en IA, controlan una parte enorme del sistema operativo del trabajo. Ahí Google y Microsoft juegan con activos de otra naturaleza: infraestructura, productividad, identidad, distribución y una presencia histórica en la empresa que cambia por completo las reglas del juego.

La mejor analogía quizá sea la del urbanismo frente a la arquitectura singular. OpenAI y Anthropic han construido edificios espectaculares que redefinen el skyline. Google y Microsoft, en cambio, además de levantar buenos edificios, controlan calles, redes, suministros y acceso al centro de la ciudad. Y cuando lo que está en juego es reorganizar la vida económica de esa ciudad, controlar la red completa puede ser más determinante que firmar el edificio más llamativo.

Aquí también conviene introducir una cautela estratégica. En torno a esta carrera seguirán apareciendo actores nuevos, etiquetas nuevas y proyectos que concentrarán conversación durante un tiempo. Algunos de ellos pueden acabar siendo relevantes. Otros no pasarán de promesa. Pero, en la conversación seria sobre implantación de IA empresarial, el criterio no puede ser la novedad. Tiene que ser la madurez operativa. Proyectos como OpenClaw o NemoClaw pueden despertar interés, curiosidad o incluso admiración técnica, pero no deberían marcar hoy las decisiones de una empresa que se juega seguridad, continuidad y cumplimiento. En consumo, la experimentación tiene otro coste. En empresa, la frivolidad tecnológica sale cara.

Por eso la foto más honesta del mercado no es la de cuatro actores equivalentes peleando en el mismo terreno. Es más precisa esta otra: OpenAI y Anthropic concentran una parte muy importante de la innovación percibida y del prestigio técnico; Google y Microsoft concentran la mayor parte de las condiciones estructurales para convertir esa innovación en infraestructura de trabajo.

Y esa diferencia es fundamental para leer lo que viene. Porque la próxima fase no la decidirá solo quién construye mejor inteligencia. La decidirá quién consigue convertir esa inteligencia en una capacidad organizativa estable, gobernable y distribuida. Y ahí, queramos o no, la conversación vuelve una y otra vez a Google y Microsoft.

Qué está aportando realmente cada actor en esta fase

Cuando se habla de IA empresarial, conviene separar muy bien la potencia tecnológica, la percepción de mercado y la capacidad real de implantación. No todos los actores están aportando lo mismo, ni todos compiten desde el mismo lugar. Algunos lideran la conversación. Otros controlan las capas donde el trabajo ya sucede. Y otros, como Apple, no están en el centro de la gran plataforma corporativa, pero sí pueden jugar un papel relevante en la última milla, especialmente cuando hablamos de dispositivo, privacidad e inferencia local.

OpenAI aporta interfaz, hábito de uso y una ofensiva clara hacia la empresa

La gran aportación de OpenAI ha sido convertir la inteligencia artificial en una interfaz cotidiana. Antes de ChatGPT, la IA generativa era una capacidad prometedora. Después de ChatGPT, pasó a formar parte del lenguaje diario de millones de personas. Ese cambio cultural tiene un valor enorme, porque OpenAI no solo lanzó un producto; cambió la expectativa del mercado sobre cómo debía usarse la inteligencia artificial.

En esta fase, además, OpenAI está desplazando claramente el foco hacia el entorno empresarial. Su apuesta ya no consiste solo en liderar la conversación pública, sino en convertirse en una capa real de trabajo dentro de las organizaciones. Ahí encajan su inversión en agentes, conectores, herramientas de ejecución, Codex y una visión cada vez más clara de superapp: un espacio unificado desde el que se conversa, se automatiza, se programa, se consulta información y se trabaja. La dirección es evidente: menos experimentación orientada al mercado doméstico y más concentración en el entorno profesional y corporativo.

Ese movimiento tiene lógica. Anthropic le ha disputado con fuerza la adopción empresarial de pago, y OpenAI ha respondido reforzando su propuesta B2B. No quiere ser solo la puerta de entrada emocional a la IA; quiere ser también una plataforma útil para el trabajo.

Ahora bien, en Europa sigue arrastrando una conversación importante en torno a GDPR, y aquí conviene ser precisos. ChatGPT Business no cumple hoy con el mismo nivel de encaje que sí ofrecen Enterprise y la API en aspectos ligados a residencia y tratamiento de datos. En cambio, la versión Enterprise y la API están mucho mejor posicionadas para responder a las exigencias corporativas y regulatorias, especialmente en organizaciones que necesitan un marco de cumplimiento más robusto. La sensación de mercado, además, es que OpenAI no tardará demasiado en cerrar también esa brecha en Business, porque sería extraño mantener mucho tiempo esa asimetría justo cuando su prioridad estratégica es ganar terreno en empresa.

Su esencia, por tanto, es esta: OpenAI aporta adopción, interfaz, velocidad y una ambición cada vez más clara de convertirse en el espacio principal desde el que se trabaja con IA. Pero su maduración empresarial no depende solo de producto y agentes; también depende de cerrar por completo la conversación regulatoria y de cumplimiento en los segmentos donde todavía no ofrece el mismo nivel de garantías que en Enterprise o en la API.

Anthropic aporta calidad de trabajo experto, precisión y una relación más exigente con el usuario

Anthropic ha conseguido algo muy relevante: pasar de ser un actor admirado por su calidad técnica a competir de forma directa con OpenAI en el entorno empresarial. Ya no es solo una alternativa sofisticada. En muchos casos, es una elección principal. Ha ganado tracción en empresa, le ha disputado el liderazgo corporativo a OpenAI y ha logrado construir una reputación muy sólida en contextos donde la precisión, el coding y el trabajo de análisis son especialmente importantes.

Su aportación más distintiva es la calidad percibida en tareas complejas. Anthropic trabaja muy bien en razonamiento, seguimiento fino de instrucciones y análisis estructurado. En el tratamiento de hojas de cálculo, tablas, comparativas y materiales que exigen orden y rigor, su rendimiento resulta especialmente convincente. No es casualidad que muchos usuarios lo perciban como una herramienta extraordinariamente útil para trabajo analítico real, no solo para conversación.

Además, su estilo de interacción tiene un rasgo muy interesante. En lugar de empujar siempre hacia la velocidad máxima, muchas veces introduce una lógica más acompañada, casi socrática, que obliga al usuario a pensar mejor lo que está haciendo. Eso ralentiza la interacción en ciertos casos, pero también la hace más precisa. No siempre es el camino más espectacular, pero sí puede ser el más útil cuando lo que importa no es llegar antes a cualquier respuesta, sino llegar mejor a una respuesta más sólida.

Dicho de forma simple, Anthropic no siempre da sensación de prisa; da sensación de criterio.

También ha sido muy inteligente con MCP, porque ha entendido que en la nueva etapa no basta con tener un gran modelo. Hay que influir en cómo se conectan modelos, herramientas y contexto. Esa visión le da relevancia más allá de Claude como producto.

Ahora bien, también arrastra fricciones. La primera tiene que ver con GDPR. Su encaje en los requisitos europeos más estrictos no siempre se percibe como plenamente resuelto. Puede cumplir muchas condiciones, sí, pero desde una lectura exigente del marco europeo sigue existiendo una sensación de cumplimiento parcial o tensionado, especialmente cuando se analiza residencia de datos y soberanía tecnológica.

La segunda fricción tiene que ver con el coste. Entre parte de sus usuarios existe descontento con el consumo de tokens y con la sensación de que ciertos usos intensivos pueden disparar la factura. Esto no invalida el producto; simplemente recuerda una verdad clásica de la empresa: no basta con que algo sea muy bueno, también tiene que sostenerse económicamente en escala.

Su esencia en esta fase sería esta: Anthropic aporta precisión, profundidad, rigor y una excelente experiencia para trabajo experto, especialmente en coding, análisis y materiales estructurados. Ha dejado de ser un actor secundario en empresa y compite de tú a tú con OpenAI. Pero aún no controla las grandes superficies corporativas donde se institucionaliza el trabajo.

Google aporta una plataforma cada vez más coherente entre IA, datos, cloud y trabajo real

Google es, probablemente, el actor que mejor representa la transición desde la guerra de modelos hacia la guerra de plataformas. Su gran fuerza en esta fase no está solo en la calidad de Gemini, sino en la capacidad de articular una lógica de conjunto. Modelos, infraestructura, nube, navegador, productividad, búsqueda y agentes empiezan a parecer partes de un mismo sistema.

Eso es lo realmente importante.

Google ya no compite únicamente como proveedor de IA avanzada. Está construyendo una arquitectura donde la inteligencia se apoya sobre una red más amplia: Google Cloud, Workspace, Chrome, Search, Android y, cada vez más, una capa empresarial de agentes conectados al dato. La entrada de Gemini Enterprise Agents en Google Cloud refuerza precisamente esa dirección. Lo que aparece aquí no es solo un chatbot potente, sino una especie de tejido multimodal que conecta datos, agentes, herramientas y operadores de una forma cada vez más natural.

La idea de fondo es muy poderosa. Google quiere que la IA no sea solo una función visible, sino una tela conectiva entre conocimiento, procesos y aplicaciones. Y lo interesante es que esa conectividad no se limita a su propio ecosistema. También puede trabajar con sistemas ajenos, incluso con entornos de Microsoft, a través de servidores MCP y mecanismos de integración. Esto eleva mucho su posición, porque le permite competir no solo como plataforma cerrada, sino como plataforma con vocación de articular contextos híbridos.

Además, Google transmite hoy una sensación de mayor finura tecnológica en IA. Tiene coherencia vertical, una propuesta cada vez más clara y una relación muy natural entre datos, agentes, modelos y productividad. Por eso, en esta fase, parece más adelantado en el plano estrictamente ligado a la evolución de la inteligencia artificial.

Su reto no es tanto técnico como de percepción y aterrizaje. Google ha tenido históricamente una tendencia a dispersar marca y producto. Pero si consigue mantener la integración actual entre cloud, Workspace, agentes y modelo, puede consolidarse como el actor que mejor ha entendido cómo convertir la IA en una plataforma de trabajo conectada al dato.

Microsoft aporta el control del entorno corporativo, aunque no lidera el imaginario de la IA

Microsoft sigue teniendo la mejor posición estructural en empresa. Esto conviene repetirlo con claridad, porque a veces el ruido del mercado hace olvidar lo esencial. La identidad, los permisos, la colaboración, la gestión documental, la productividad, el desarrollo y la administración forman parte del territorio donde Microsoft lleva décadas instalado. Y eso le da una ventaja extraordinaria cuando la IA empieza a integrarse en el trabajo real.

Su gran aportación en esta fase no es tanto el brillo aspiracional como el punto de control. Microsoft puede insertar inteligencia en Microsoft 365, en Teams, en Outlook, en SharePoint, en GitHub, en Azure y en toda la capa de identidad y gobierno corporativo. No necesita inventar una entrada nueva en la empresa. Ya ocupa muchas de las puertas principales.

La analogía más clara sería esta: en una nueva ciudad de inteligencia artificial, Microsoft no parece el arquitecto más rompedor del skyline, pero sigue teniendo la propiedad del suelo urbano más valioso.

Ahora bien, también hay que introducir una tensión real. Existe insatisfacción entre parte de sus usuarios. Microsoft no suele estar en la conversación de IA con la misma fuerza emocional que OpenAI, Anthropic o incluso Google. Su propuesta se percibe a menudo como más fragmentada, menos inspiradora y más compleja de navegar. Y eso importa, porque la IA no se implantará solo por posición administrativa; también necesita generar convicción de producto.

Además, el mercado le exige demostrar que su ventaja corporativa puede convertirse en liderazgo visible en IA, no solo en integración defensiva. Ahí hay presión. Porque Microsoft tiene las mejores cartas del entorno empresarial, sí, pero no puede vivir indefinidamente solo de esa posición. También necesita pulsar el botón de turbo en experiencia, simplicidad y sensación de avance.

Su esencia, por tanto, es esta: Microsoft aporta la capa más valiosa para gobernar la IA en empresa (identidad, permisos, distribución y control), pero no domina hoy la conversación aspiracional de la IA ni transmite la misma frescura tecnológica que Google.

Apple aporta consumo, endpoint profesional e inferencia local en entornos controlados

Apple no compite en esta fase en el núcleo de la gran plataforma corporativa de IA. No controla la nube empresarial, no domina la suite de productividad de referencia y no marca la conversación sobre identidad, compliance o despliegue de agentes corporativos. Intentar colocarla en ese lugar sería leer mal el mercado.

Pero tampoco sería inteligente dejarla fuera del mapa.

Apple aporta una lógica distinta y muy relevante. En el entorno doméstico, puede llegar a ser dominante porque controla dispositivo, sistema operativo, privacidad, experiencia y distribución masiva. Ahí su posición es potentísima. Si consigue que la IA se convierta en una capa natural de la experiencia personal, puede capturar una enorme parte del consumo cotidiano.

En el entorno corporativo, su papel es otro. No es el gran cerebro de la IA empresarial, pero sí puede aportar algo muy valioso en la última milla: endpoint seguro, experiencia cuidada y estaciones profesionales preparadas para inferencia local. Aquí entran especialmente Mac mini y Mac Studio. Estos dispositivos no sustituyen a Google, Microsoft, OpenAI o Anthropic como plataformas corporativas, pero sí abren una vía muy interesante para ejecutar modelos locales, experimentar con cargas cercanas al dato, trabajar con más control y reducir dependencia de nube en determinados casos de uso.

Ese papel no debe exagerarse, pero tampoco minimizarse. Apple no está en el centro de la guerra de plataformas empresariales, pero sí puede ser muy importante en el espacio donde el dispositivo, la privacidad y el procesamiento local empiecen a ganar peso.

La lectura de conjunto

La foto más útil de esta fase sería esta:

- OpenAI aporta adopción, interfaz y ambición de convertirse en el espacio natural de trabajo con IA.

- Anthropic aporta precisión, calidad de trabajo experto y una experiencia especialmente valiosa en análisis, coding y materiales estructurados.

- Google aporta coherencia de plataforma, integración con datos y una sensación clara de liderazgo tecnológico en IA.

- Microsoft aporta el control del entorno corporativo, que sigue siendo la capa más difícil de desplazar.

- Apple aporta dominio potencial en consumo y un papel cada vez más interesante en endpoint profesional e inferencia local.

Cuando se mira así, el mercado deja de parecer una carrera caótica. Cada actor revela su esencia. Y eso permite una lectura más madura: la batalla de la IA empresarial no se decidirá solo por quién tenga el modelo más brillante, sino por quién consiga alinear mejor inteligencia, contexto, control, integración y superficie de trabajo.

Conclusión

La inteligencia artificial ha dejado de ser una promesa tecnológica para convertirse en una disputa por el control del trabajo. Esa es, probablemente, la idea más importante de todo este análisis. Durante un tiempo parecía que la carrera se decidiría en el laboratorio, en los benchmarks o en la brillantez del siguiente modelo. Hoy está mucho más claro que la partida real se juega en otro sitio: en la capacidad de convertir esa inteligencia en una infraestructura útil, gobernable y distribuida dentro de la empresa.

Por eso la conversación relevante ya no puede limitarse a preguntar qué modelo es mejor. La pregunta estratégica es otra: quién está construyendo la plataforma capaz de integrar inteligencia, contexto, herramientas, seguridad, memoria, agentes y gobierno del dato dentro del sistema operativo de la organización. Y cuando se observa el mercado desde esa perspectiva, el mapa se ordena mejor.

OpenAI ha sido decisivo para hacer que la IA se vuelva cotidiana. Ha creado hábito, interfaz y una nueva manera de relacionarse con esta tecnología. Anthropic ha demostrado que la calidad, la precisión y el trabajo experto pueden convertirse en una ventaja empresarial muy seria, hasta el punto de disputarle a OpenAI parte del liderazgo corporativo. Google está mostrando una coherencia cada vez mayor entre modelos, cloud, datos, productividad y agentes, y hoy parece más fino en el plano estrictamente ligado a la evolución de la IA. Microsoft, aunque no lidera necesariamente el imaginario más inspirador del mercado, sigue teniendo la posición estructural más potente dentro de la empresa, porque controla identidad, permisos, productividad, distribución y gobernanza. Apple, por su parte, no está en el centro de la gran plataforma corporativa, pero sí puede jugar un papel muy relevante en consumo, endpoint profesional e inferencia local con equipos como Mac mini y Mac Studio.

La conclusión, por tanto, no es que haya un ganador claro. Sería demasiado pronto y, además, demasiado simple. Lo que sí parece evidente es que esta carrera ya no se resolverá solo por la calidad del modelo. Se resolverá por la capacidad de ensamblar una arquitectura completa de trabajo con IA. Y ahí la batalla principal parece concentrarse en Google y Microsoft, aunque OpenAI y Anthropic sigan siendo fundamentales para empujar la frontera y Apple tenga una posición singular en la última milla.

Para la empresa, la lección es muy clara. No conviene dejarse arrastrar ni por el brillo del momento ni por el ruido de las nuevas etiquetas. Tampoco por la tentación de confundir promesa con madurez. La implantación seria de IA empresarial exige pensar en plataforma, no en fuegos artificiales. Exige mirar seguridad, identidad, conectores, memoria, costes, experiencia de usuario, encaje regulatorio y capacidad de despliegue. Y exige entender que la inteligencia, por sí sola, ya no basta. Lo que crea ventaja real es la forma en que esa inteligencia se integra en la estructura del negocio.

En el fondo, de eso trata esta nueva etapa. No de quién tiene la IA más espectacular, sino de quién conseguirá que la inteligencia artificial deje de ser una herramienta llamativa y pase a convertirse en una capacidad estructural de la empresa. Ahí se está decidiendo mucho más que una carrera tecnológica. Ahí se está rediseñando el trabajo.